あなたの家族や友人がソーシャルメディアプラットフォームに写真やビデオをアップロードするたびに、顔認識アルゴリズムがあなたの人物、あなたが知っている人、あなたがどこにいるのかを知ることができます。

人々のプライバシーに関する懸念を説明するために、トロント大学(T of U)の研究者は アルゴリズム 顔認識システムを混乱させる可能性があり、システムがあなたについてもっと学習することを禁止します。

アルゴリズムを説明した完全な研究が利用可能です こちら.

「敵対的に攻撃することで、最先端の顔検出アルゴリズムを欺くことができます」と述べています。 Avishek Bose、電気学科の大学院生

TのUでコンピュータ工学と研究の共同著者。

「顔の認識がますます良くなるにつれて、個人のプライバシーは本当に問題になります」 Parham AarabiTのUの電気とコンピュータ工学科の准教授と研究の共著者は、声明の中で言いました。 「これは、有益な対顔認識システムがその能力に対抗できる1つの方法です。」

技術

チームのソリューションは、2つの人工知能アルゴリズム、顔検出器と敵対的ジェネレータを互いに競合させることを含む、とBoseは説明した。

顔検出器は顔を識別するために働き、敵対発生器は顔検出器を完全に破壊するように働く。

「顔検出器は敵対的な生成器の存在についての知識を持っていませんが、生成器は検出器をいかに上手にだますかを学習しています」とボーズは言った。 「当初、ジェネレータはそうするのが非常に苦手ですが、顔検出器の出力によって決定されるように、それはその間違いを観察することを通して学習します。」

敵対的なジェネレータは、最終的に顔検出器を時間のほぼ99%をだますことができるポイントに達する。

本質的に、研究者は個人のプライバシーを保護するために写真に適用できるInstagramのようなフィルタを作成しました。

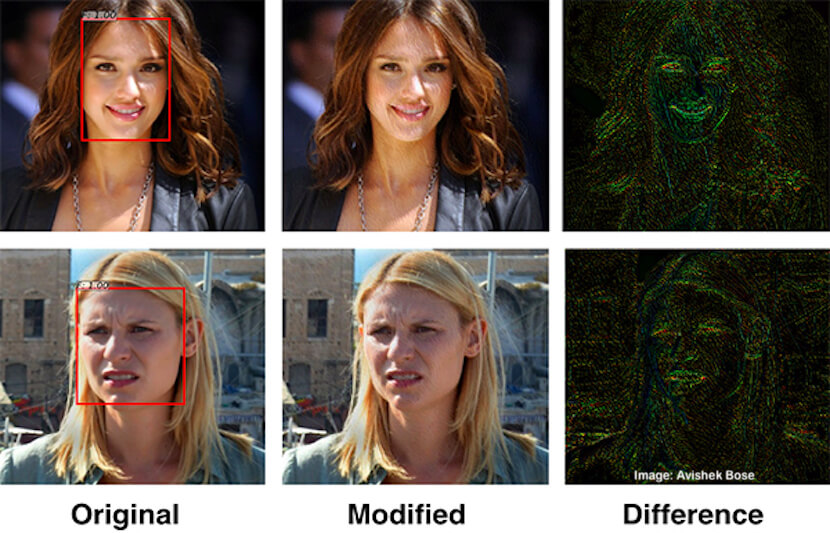

新しいアルゴリズムは、人間には知覚できないが、最先端の顔検出器をだますことができる、画像内のピクセルをわずかに変化させる。

「破壊的なAIは、顔検出用のニューラルネットが求めているものを「攻撃」する可能性があります」とBoseは声明の中で述べています。 「たとえば、検出AIが目の角を探している場合、目の角を調整して目立たないようにします。 それは写真に非常に微妙な擾乱を引き起こします、しかし検出器にとって彼らはシステムをだますのに十分に重要です。」

研究者は、さまざまな民族、環境、照明条件など、600の顔のプールでシステムをテストしました。

このシステムは、認識装置が元々100%近くから0.5%にしか検出できなかった顔の量を効果的に削減しました。

さらに、この技術は、画像ベースの検索、民族性の推定、特徴の識別、感情、および自動的に抽出することができる他の顔に基づく属性を混乱させる可能性がある。

動機

この研究は、現代のディープラーニングベースの顔検出および認識アルゴリズムの失敗モードを研究することへのAarabiとBoseの関心によって引き起こされました。

「最初は、ぼかし、明るさ、薄暗さなどの極端な条件でこれらのアルゴリズムをテストすることから始めました」とBoseは言います。

彼らの実験から、まともな状態の画像でも装置が故障することがあることに気付きました。これは、対抗攻撃に関する新しい文献のいくつかとよく繋がっています。

「本質的に敵対的な攻撃は、入力画像に小さな、そしてほとんど気付かれないほどの変化を引き起こし、それは機械学習モデルを壊滅的に失敗させる原因となります」とBoseは言いました。

「これは多くのディープラーニングモデルで知られている現象ですが、顔検出/認識システムのコンテキストで調査されたことはありませんでした。」

次は何ですか?

AarabiとBoseはこの攻撃スタイルを他の種類の検出器に拡張したいと考えています。 場合によってはこれが困難または不可能かもしれないが、主な目的は概念を理解し、特徴づけることである。

研究者が複数の種類の検出器に対してこの作業を成功させると、ツールを作ることができますが、それでもまだこれからはありません。

「将来的には、インターネットにアップロードする前に、このプライバシーフィルタを写真に適用するアプリを想像することができます」と彼は説明します。

しかし、現時点ではまだ多くの研究が行われていなければなりません。

「最終目標に近いものではなく、私たちの論文が出発点にすぎません」とBose氏は言います。

ボーズ氏は、研究者が最先端の顔検出アルゴリズムをだますことができたが、顔検出装置をすべて攻撃することはできないと主張している。

「これは、ユーザーが自分のプライバシーを保護する権限を与えるという大きな目標への小さな一歩です」とBose氏は述べています。