クイーンズランド工科大学 (QUT) の XNUMX 人のロボット工学者チームは、 より速く、より正確な方法を開発しました ロボットがリアルタイムで物体を把握できるようになり、産業環境と家庭環境の両方で応用の扉が開かれます。

彼らの 紙 カーネギーメロン大学の国際ロボット会議で発表されました。 ロボット工学: 科学とシステム、 先週。

赤ちゃんの一歩を踏み出す

ロボット工学が未来の道であることは誰も否定できません。 による 国際データ株式会社、世界のロボット工学への支出は135年までに2019億ドルに達すると予想されています。

ロボットは長い間、組み立てラインや計算において人間の労働力に取って代わり、チェスやディベートにおいて人間と同じように見たり聞いたり考えたりするようになってきましたが、ロボットが完全に把握できないことが XNUMX つあります。それは、構造化されていない環境で物体を拾うことです。

人間の場合でも、気づかれてはいませんが、人間の指にある何千ものセンサーと人間の脳内の複雑な回路ネットワークのおかげで、生後 XNUMX か月の赤ちゃんでもおもちゃのガラガラを拾うことができます。 しかし、彼は明らかに何時間ものトレーニングや何百人もの研究者に教えてもらう必要はありません。

しかし、ロボットにとって、構造化されていない環境で物体をつかむことは非常に困難です。 しかし、ロボットが人間の周囲で役立つためには、変化する環境に適応する方法を知る必要があります。

QUT チームは、ロボットがランダムに移動するアイテムをより迅速かつ正確に把握するための新しい方法を開発しました。

「私たちは、現実世界で役立つタスクを実行するロボットの作成に興味を持っています。 私はしばらくの間、ロボットが世界と確実に対話し、物体を拾い上げて正しく配置できるようにすることに興味がありました。」 ユルゲン・ライトナー、ポスドク研究員 QUTさん 理工学部。 「チェスなど、私たちにとって難しいことの一部は、コンピューターにとっては簡単ですが、物をつかむなど、私たちにとって簡単なことの一部は、ロボットにとっては非常に難しいことがわかりました。」

新しいアプローチ

深層学習技術により、ロボットは何千ものサイズや形状から学習し、静止状態で未知のアイテムを把握する最適な方法を計算できます。

たとえば、物体認識に最も広く使用されている畳み込みニューラル ネットワーク (CNN) を備えたロボットは、物体を個別にサンプリングしてランク付けし、可能な限り最適なグリップを考えます。 ただし、この手法は静的環境であっても長い計算時間がかかります。

しかし、研究者らの手法は、環境を直接スキャンし、深度画像を使用してキャプチャした各ピクセルをマッピングする生成把握畳み込みニューラル ネットワーク (GG-CNN) に基づいており、移動する物体を把握するのに十分な速度を備えています。

「生成的把握畳み込みニューラル ネットワークのアプローチは、ピクセルごとに XNUMX 本指での把握の品質と姿勢を予測することで機能します。 シングルパスで深度画像を使用して目の前にあるものをマッピングすることにより、ロボットは決定を下す前に多くの異なる把握をサンプリングする必要がなく、長い計算時間を回避できます」と QUT 博士研究員のダグラス・モリソン氏は述べています。 ステートメント.

2017 年の Amazon ピッキング チャレンジで優勝した以前のロボットは、単に物体の入った箱を調べ、可能な限り最適なグリップを計算し、盲目的に物体を拾いに行っただけでしたが、最新バージョンでは物体の画像を約 20 ミリ秒以内に処理します。

ライトナー氏によると、現在のロボットは物体を拾った後、それを一定の場所に置き、現場で次の物体を探し始めます。

予測不可能な世界

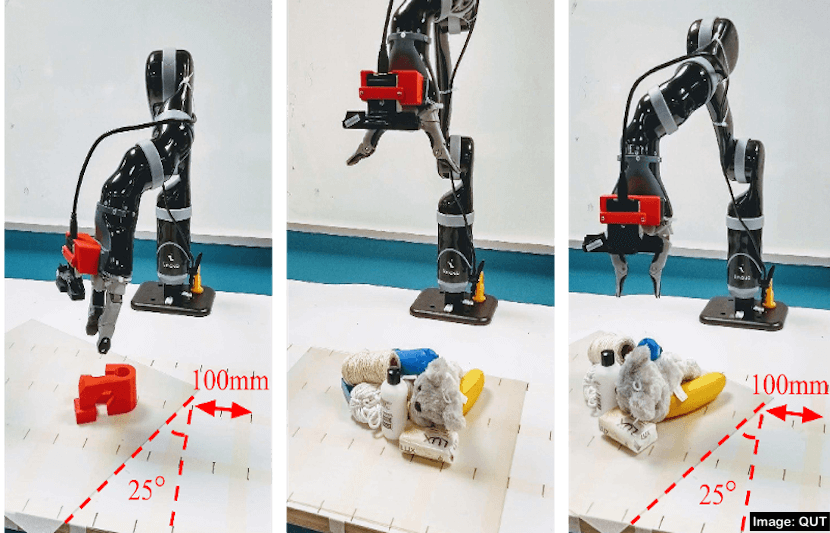

研究者らは、新しいアプローチを複数の方法でテストしました。

「さまざまな実験設定があり、すべて現実世界のロボットや物体が使用されていました」とライトナー氏は語った。 「私たちはさまざまな『家庭用品』や 3D プリントされた物体を使ってテストし、ロボット コントローラーのさまざまなノイズ レベルでのアプローチを検証しました。」

まず、静的環境と移動環境の両方で、敵対的な幾何学形状を持つ目に見えない物体と家庭用物体を把握する試験を 10 回実行しました。

このロボットは、静的環境下では敵対的な形状に対して 84%、家庭用物品に対して 92% の把握成功率を達成しましたが、移動環境下ではそれぞれ 83% と 88% を達成しました。

次に、10 個のテスト対象物を箱の中で混ぜ、ロボットの下に散らかった山に注ぎ、ロボットがそれらを 10 つずつ掴めるようにしました。 次に、彼らは静的環境と移動環境の両方で把握に関する XNUMX 回の試行を実行しました。

ロボットは、静止環境下では 87% の把握成功率を達成しましたが、移動環境下では 81% を達成しました。

「この新しい方法を使用すると、ロボットが見る物体の画像を約 20 ミリ秒以内に処理できるため、ロボットは物体を掴む場所に関する決定を更新し、より大きな目的を持って掴むことができます。 これは、散らかった空間では特に重要です」とレティナー氏は声明で述べた。

次のステップ

研究者らは、ロボットが産業環境や家庭環境で人間の周囲でより安全かつ広範囲に使用されるように、手法をさらに改善したいと考えている。

「この一連の研究により、工場全体がロボット機能に基づいて構築される構造化された環境だけでなく、ロボットシステムを使用できるようになります」とライトナー氏は声明で述べた。 「これは、オンラインショッピングや仕分けのための倉庫から果物の収穫に至るまで、業界にとってメリットがあります。 掃除機をかけたり床にモップをかけたりするだけでなく、物を拾ったり片付けたりするためのよりインテリジェントなロボットが開発されているため、家庭にも応用できる可能性があります。」

ライトナー氏によると、彼らはまた、さまざまな環境におけるロボットの視覚や操作スキルなど、現在のアプローチの限界の一部を克服することにも取り組んでいるという。

現在、「ロボットお片づけマイルームチャレンジ」の開催を計画中だという。